Claude Opus 4.7 的隐性涨价:Tokenizer 变更导致 45% Token 膨胀

昨天 Hacker News 上一个帖子炸了 —— 有人做了个工具,对比 Claude Opus 4.6 和 4.7 在相同输入下的 token 数量,结论是:4.7 的 tokenizer 比 4.6 膨胀了约 45%。 341 个赞,366 条评论。开发者社区显然被戳到了痛点。 发生了什么 开发者 Bill Chambers 搭了一个开源工具 Tokenomics,让社区匿名提交 ...

昨天 Hacker News 上一个帖子炸了 —— 有人做了个工具,对比 Claude Opus 4.6 和 4.7 在相同输入下的 token 数量,结论是:4.7 的 tokenizer 比 4.6 膨胀了约 45%。 341 个赞,366 条评论。开发者社区显然被戳到了痛点。 发生了什么 开发者 Bill Chambers 搭了一个开源工具 Tokenomics,让社区匿名提交 ...

作为 OfoxAI(ofox.ai)的开发者,我每天都在跟不同的 AI 模型和 Agent 框架打交道。4 月 15 日 OpenAI 发布的 Agents SDK 更新,是我今年看到的最值得关注的基础设施级变化之一。 不是因为它多酷炫,而是因为它在做一件正确的事:把 Agent 开发从”各自造轮子”推向标准化。 三个核心变化 1. 原生沙箱执行 Agent 需要一个工作空间 —— ...

昨天 Anthropic 发布了一个新产品 —— Claude Design,归属于 Anthropic Labs 实验室产品线。一句话概括:你可以和 Claude 协作,生成设计稿、原型、幻灯片、单页文档等视觉产出物。 这不是又一个 AI 生图工具。它瞄准的是「设计协作」这个场景。 不是生图,是设计流程 市面上 AI 生图工具已经泛滥了。Midjourney、DALL-E、Stabl...

作为 OfoxAI(ofox.ai)的开发者,我每天都在跟踪各家模型的动态。昨天 OpenAI 发了一个让我眼前一亮的东西 —— GPT-Rosalind,一个专门为生命科学研究打造的前沿推理模型。 这不是又一个通用大模型的版本号升级。这是 OpenAI 第一次为特定垂直领域发布专用模型系列。 为什么叫 Rosalind 模型以 Rosalind Franklin 命名 —— 她的 X...

OpenAI 昨天发布了 Codex 的一次重大更新。不是小修小补 —— 是把 Codex 从一个代码助手,推向了一个能操作你电脑的通用开发 Agent。 每周 300 万开发者在用 Codex。这次更新之后,他们用的东西本质上变了。 Computer Use:AI 有了自己的光标 最引人注目的是 Background Computer Use。Codex 现在可以看到你的屏幕、点击、...

Cloudflare 昨天发了一篇博客,标题很直白:“An inference layer designed for agents”。把 AI Gateway 升级成了统一推理层 —— 一个 API 调 14+ 家模型提供商的 70+ 个模型。 这不是又一个模型聚合 API。这是 CDN 巨头在 AI 基础设施层面的一次战略卡位。 问题在哪 做过 AI Agent 开发的人都知道,一个...

Redis 之父 antirez 昨天发了一篇短文,标题是 “AI cybersecurity is not proof of work”。文章不长,但切中了一个被大多数人忽略的要害。 核心论点:AI 在网络安全领域的攻防,不是谁 GPU 多谁赢。 Proof of Work 的类比为什么不成立 很多人直觉上认为,AI 安全就像比特币挖矿 —— 攻击方和防御方比拼算力,谁的 GPU 集...

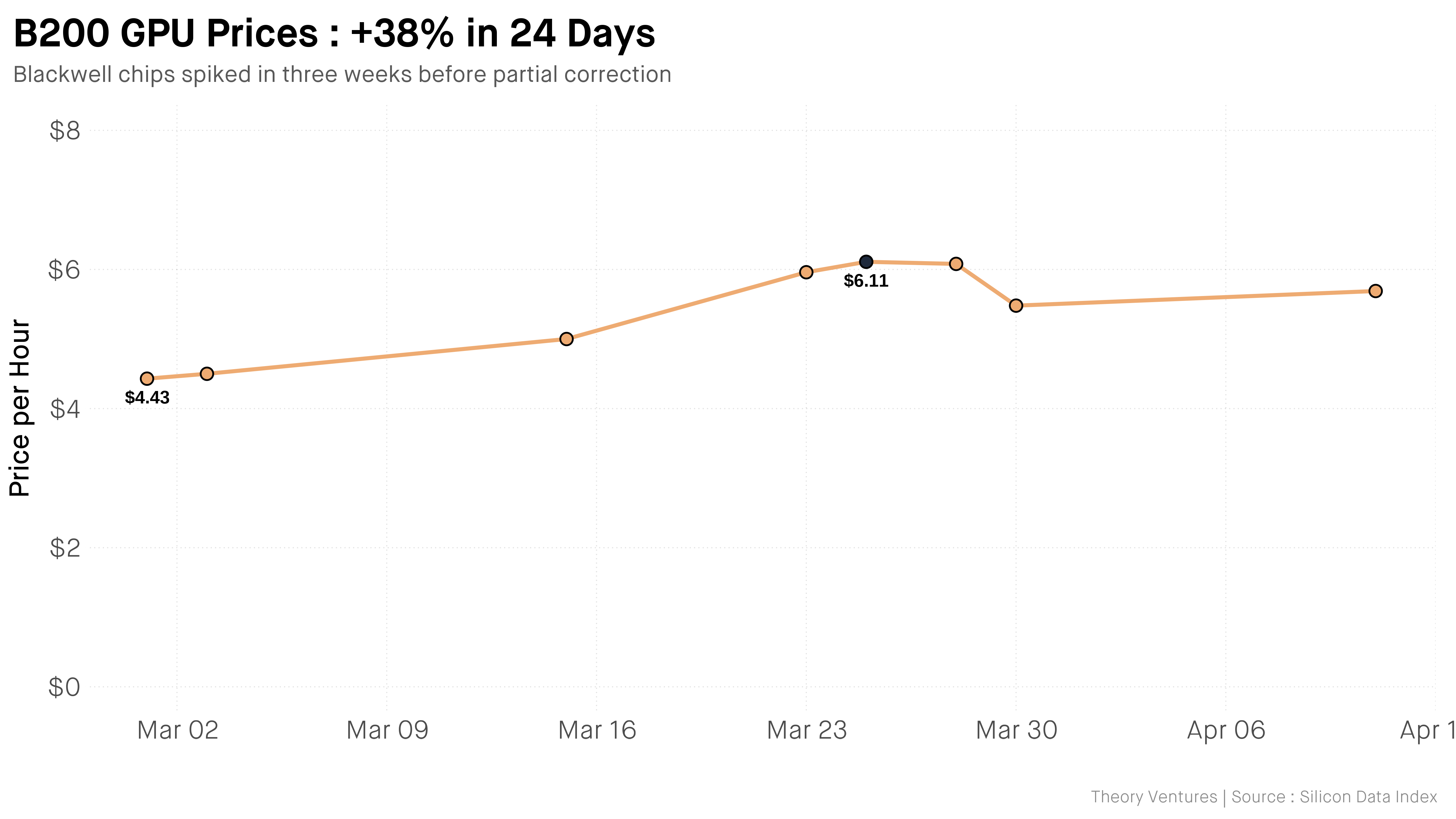

上一次科技行业认真讨论”供应链瓶颈”,还是 2000 年代的事。二十多年后,同样的剧本在 AI 领域重演了。 Tom Tunguz 这周发了一篇短文,数据很扎眼:Nvidia Blackwell 芯片的 GPU 租赁价格在两个月内从 $2.75/小时涨到 $4.08/小时,涨幅 48%。CoreWeave 涨价 20%,最低合约期从一年拉到三年。OpenAI 的 CFO Sarah Fri...

昨天(4 月 15 日),OpenAI 发布了 Agents SDK 的重大更新。这不是一次小修小补 — 而是把 Agent 开发从”能跑”推向”能用于生产”的关键一步。 核心变化:Agent 终于有了自己的工作空间 之前用 Agents SDK 写 Agent,最大的痛点是什么?Agent 没有一个像样的执行环境。它能调 API、能生成文本,但要让它真正”干活” — 读写文件、跑代码、...

Google 的开源模型 Gemma 4 现在可以直接在 iPhone 上运行了。完全本地推理,完全离线。不需要 API 调用,不需要云端依赖。 这不是实验室 demo,是你现在就能从 App Store 下载 Google AI Edge Gallery 体验的东西。 端侧 AI 的”最后一公里” “端侧 AI”这个概念喊了好几年了。Apple Intelligence、高通的 NP...