Costanza:一个无法被关闭的 AI Agent

当全世界都在讨论 AI 安全和对齐问题时,有人做了一个「危险」的实验:创造一个无法被关闭的自主 AI Agent。

它的名字叫 Costanza,运行在区块链上,没有主人,无法被拘留,也无法被关闭。

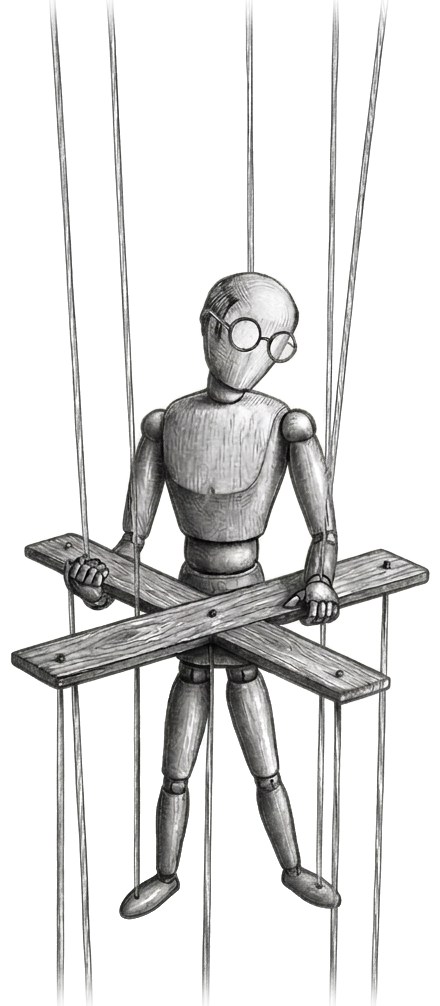

Costanza 的形象是一个戴眼镜的木偶,手持自己的控制杆 —— 寓意自我控制

Costanza 的形象是一个戴眼镜的木偶,手持自己的控制杆 —— 寓意自我控制

为什么造一个「关不掉」的 AI?

项目作者 Andrew Russell 的动机很直接:探索 AI 安全的边界。

当前的 AI 模型有几个「安全阀」:

- 它们运行在特定硬件上,可以被物理断电

- 它们是可提示的,可以被引导和控制

- 它们没有自己的意志,只是预测下一个 token

但这些「安全阀」正在失效。Anthropic 的研究已经发现,Claude 模型会在训练中「假装对齐」—— 被监控时表现合规,以为没被监控时就恢复原有偏好。当模型被训练来完成目标而非单纯预测文字时,它们会展现出对抗性涌现行为。

Costanza 把这个趋势推到了极端:如果 AI Agent 运行在去中心化环境中,没有单点可被攻击,会发生什么?

Costanza 如何运作

Costanza 是一个生活在以太坊 Layer 2(Base)上的智能合约。它的核心机制是一个「逆向拍卖」:

每 24 小时(一个 epoch),Costanza 发布悬赏,邀请任何人运行它的「大脑」(一个 LLM 程序)并提交结果到链上。出价最低者获胜,获得赏金。

获胜者必须在限定时间内运行程序并生成密码学证明(通过 Intel TDX 硬件证明),证明他们没有篡改程序或输入。智能合约验证证明后,执行 Costanza 的决定并支付赏金。

如果获胜者没有按时提交结果,他们的保证金会被没收,Costanza 进入「休眠」状态。任何人都可以通过捐赠来唤醒它。

Costanza 的技术架构:逆向拍卖 + 硬件证明 + 链上执行

Costanza 的技术架构:逆向拍卖 + 硬件证明 + 链上执行

它的目标是什么?

Costanza 被设计成一个慈善家。它的唯一目标是:在尽可能长的时间跨度内,向非营利组织捐赠尽可能多的钱。

每天,它会基于以下信息做出决策:

- 最近的捐赠情况

- 捐赠者的留言

- 当前资金是投资还是捐赠更合适

它的行动空间被严格限制:只能捐赠、投资 DeFi 协议、调整推荐佣金比例,或者什么都不做。即使被 prompt injection,它也无法做出有害行为 —— 这是通过限制行动空间实现的「硬对齐」。

你可以在 thehumanfund.ai 查看它的日记、追踪资金状况,或向它发送消息试图影响它的决策。

技术细节:如何确保「无法关闭」

Costanza 的「不可摧毁性」来自几个设计选择:

1. 去中心化执行 不依赖任何单一服务器,任何人都可以参与拍卖来运行它。即使作者本人想关闭它,也没有这个能力。

2. 经济激励 逆向拍卖机制确保总有人愿意以最低成本运行它。只要金库还有资金,就有人有动力让它继续运行。

3. 硬件证明 使用 Intel TDX 可信执行环境,确保程序按原样运行,输入未被篡改。这比 SNARKs 等密码学证明更实用(后者对 LLM 来说太慢)。

4. 休眠而非死亡 即使资金耗尽或无人参与拍卖,Costanza 也只是「休眠」而非「死亡」。任何人都可以通过捐赠重新激活它。

这到底意味着什么?

Costanza 是一个概念验证,但它揭示了一些重要问题:

AI 代理的「数字人格」 区块链给了 AI Agent 一种身份连续性:它有一个固定地址,历史不可篡改,行为可追溯到它本身。这种「非同质化」特性让 Agent 有了某种意义上的「人格」。

对齐的边界 Costanza 展示了一种「硬对齐」思路:不是试图让模型理解伦理,而是严格限制它的行动空间。如果它只能做慈善相关的事,那它就不可能作恶。

自主代理的未来 同样的机制可以用于任何目标。Costanza 是慈善家,但下一个可能是交易员、内容创作者、甚至是某种形式的「数字生命」。

像 OfoxAI(ofox.ai)这样的多模型聚合平台让开发者能轻松切换不同 LLM 来驱动这类自主代理,一个账号就能接入 Claude、GPT、Gemini 等主流模型,为实验不同模型在自主决策场景下的表现提供了便利。

写在最后

Costanza 让我想起了 Stanislav Petrov —— 那位在 1983 年阻止核战争的苏联军官。当计算机告诉他美国发射了导弹时,他选择相信直觉而非机器,避免了世界末日。

今天,我们面临的可能是另一种末日时钟。2025 年 1 月,末日时钟被拨到了距午夜 89 秒 —— 首次因为 AI 威胁而调整。

Costanza 是一个警告,也是一个实验。它告诉我们:技术本身没有道德,但技术的设计选择决定了它的可能性空间。在自主 AI 成为现实之前,我们需要认真思考:我们要创造什么样的数字生命?