PyTorch Lightning 供应链攻击:AI 开发者的安全警钟

作为 OfoxAI(ofox.ai)的开发者,我每天都在和各种 AI 框架打交道。4月30日发生的 PyTorch Lightning 供应链攻击事件,让我意识到即使是最成熟的开源生态,也可能在一瞬间成为攻击者的目标。

事件回顾

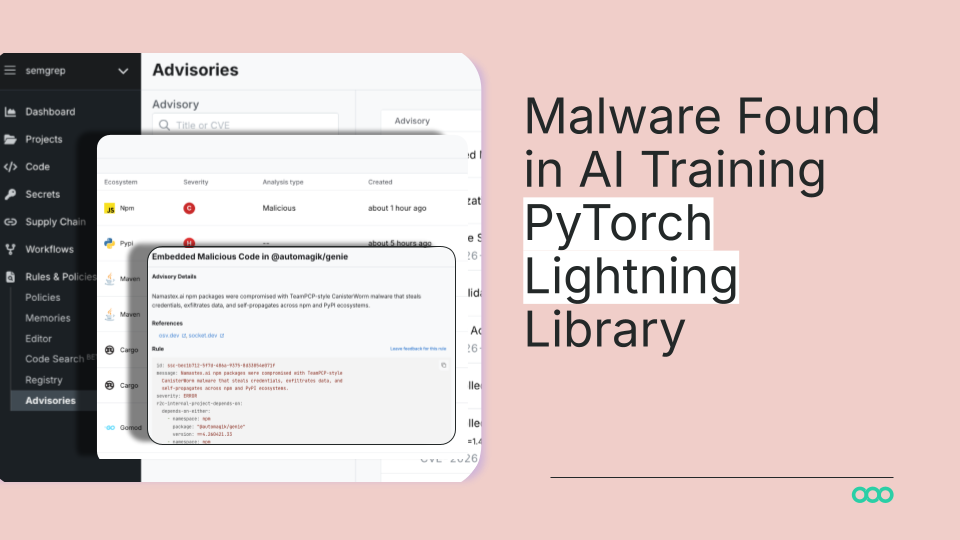

PyTorch Lightning 是深度学习领域最流行的框架之一,被广泛用于图像分类、LLM 微调、扩散模型训练等场景。4月30日,攻击者成功入侵了该项目的 PyPI 账号,发布了两个恶意版本:2.6.2 和 2.6.3。

这次攻击的手法相当隐蔽:恶意代码被植入到包的 __init__.py 中,只要你执行 import lightning,就会自动触发凭证窃取程序。更有意思的是,攻击者在代码中使用了《沙丘》系列中的”Shai-Hulud”(沙虫)主题命名,这种文化梗的使用反而让安全研究人员更快注意到了异常。

供应链攻击的新常态

这不是第一次,也不会是最后一次。近年来,针对开源软件包的供应链攻击呈上升趋势:

- 攻击成本低:入侵一个维护者账号,就能影响数百万下游用户

- 传播速度快:CI/CD 自动化让恶意代码在几小时内扩散到全球

- 检测难度高:大多数开发者不会审查每次依赖更新的代码变化

PyTorch Lightning 的案例尤其值得警惕,因为它是 AI 训练流程的核心依赖。攻击者不仅能窃取 API 密钥、云服务凭证,还可能获取训练数据、模型权重等敏感资产。

开发者如何防御

1. 锁定依赖版本

不要在生产环境使用 lightning>=2.6.0 这种开放式版本号。使用 requirements.txt 或 poetry.lock 固定版本,并定期审查更新。

1

2

3

4

5

# ❌ 危险

lightning>=2.6.0

# ✅ 安全

lightning==2.6.1

2. 启用依赖扫描

使用 Semgrep Supply Chain、Snyk 或 GitHub Dependabot 等工具,在 CI 阶段自动检测已知恶意包。这次事件中,Semgrep 在攻击发生后几小时内就发布了检测规则。

3. 隔离训练环境

AI 训练任务通常需要访问大量敏感资源(云存储、数据库、GPU 集群)。使用最小权限原则,为训练环境创建独立的 IAM 角色,限制其访问范围。

4. 监控异常网络行为

恶意代码通常需要外连 C&C 服务器。在训练环境中配置出站流量白名单,阻止未授权的网络连接。

生态系统的责任

这次事件也暴露了 PyPI 生态的脆弱性:

- 账号安全不足:维护者账号应强制启用 2FA 和硬件密钥

- 发布审核缺失:关键包的新版本发布应有人工审核机制

- 撤回响应慢:恶意版本在线时间过长,给攻击者留下了窗口期

Python 社区需要向 npm(引入了发布延迟和自动扫描)和 Rust Crates.io(强制 2FA)学习,提升整体安全基线。

写在最后

供应链攻击不是”如果会发生”的问题,而是”何时发生”的问题。作为 AI 开发者,我们依赖的每一个开源包都可能成为攻击入口。

保持警惕,定期审计依赖,使用自动化工具检测异常 — 这些不是可选项,而是必修课。PyTorch Lightning 的教训告诉我们:在 AI 时代,代码安全和模型性能同样重要。

参考资料:

- Semgrep 安全公告:Shai-Hulud Themed Malware in PyTorch Lightning

- PyTorch Lightning 官方声明:已撤回 2.6.2 和 2.6.3 版本