HN 上的 LLM 论文正在消失,这说明了什么?

Dylan Castillo 做了一件有意思的事:他让 Claude 分析了 Hacker News 上 arXiv 论文的占比变化,发现了一个明显的趋势 — LLM 相关的学术论文正在从 HN 首页消失。

不是 LLM 研究变少了,是社区对论文的兴趣在急剧下降。

数据说了什么

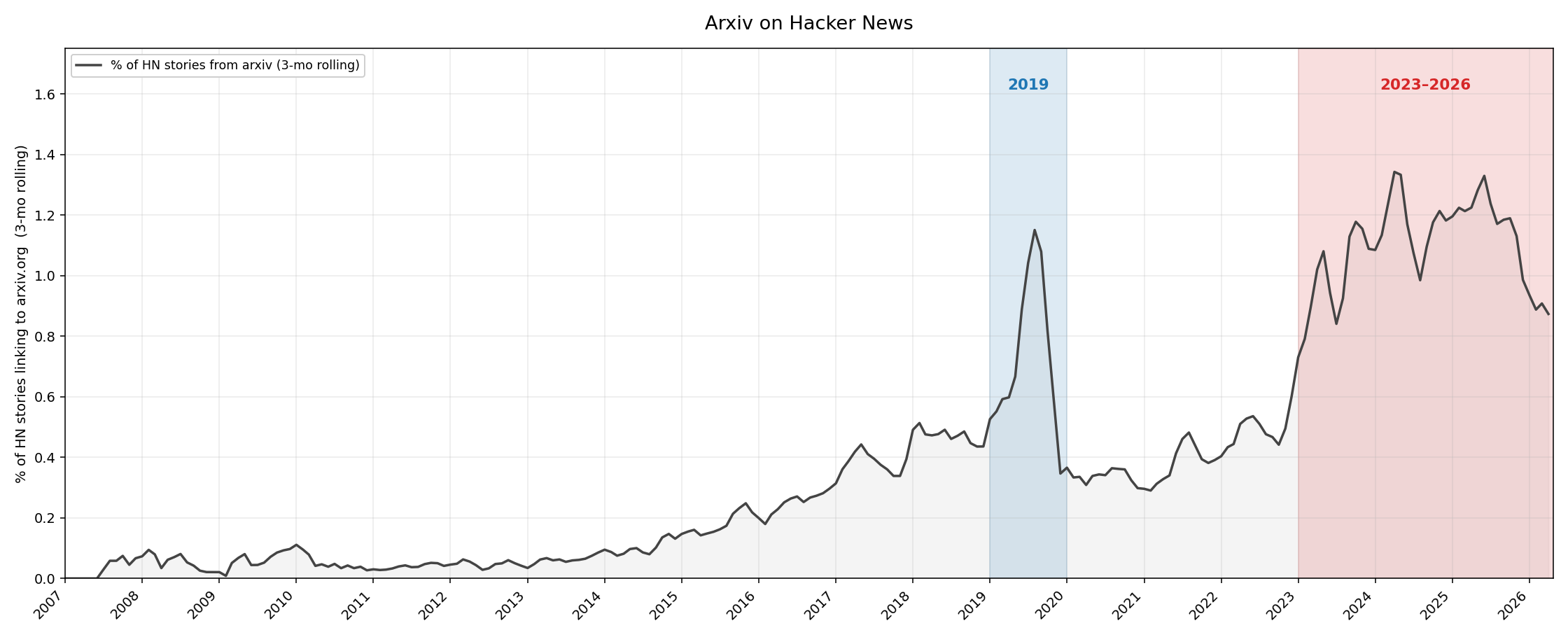

通过查询 BigQuery 上的 HN 数据集,按月统计 arXiv 链接的占比,趋势一目了然:

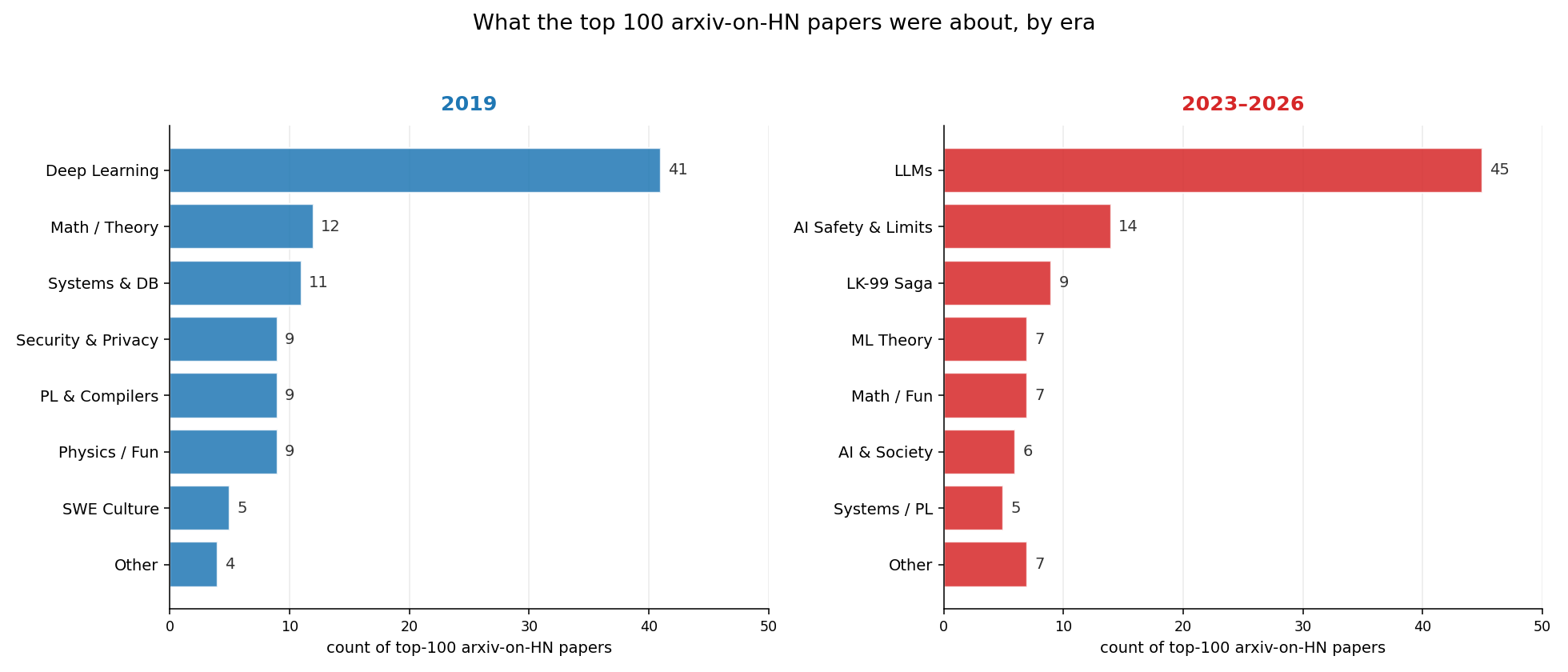

有趣的是,历史上有过一次类似的高峰 — 2019 年。那一年的 top 100 论文中 41% 是深度学习相关的,MuZero、EfficientNet、XLNet 这些名字至今仍被频繁引用。

而 2023-2026 年的高峰更猛烈:top 100 中 59% 是 LLM 或 AI 相关。但这个高峰正在快速回落。

不同时期 arXiv 论文的主题分布,LLM 时代的集中度远超深度学习时代

不同时期 arXiv 论文的主题分布,LLM 时代的集中度远超深度学习时代

为什么论文不再吸引眼球

我的判断:LLM 正在从研究阶段进入工程阶段。

2023 年初,一篇关于 Chain-of-Thought 或者 RLHF 的论文能让整个社区兴奋,因为大家在理解「这东西到底怎么工作的」。到了 2026 年,大多数开发者更关心的是「怎么用好它」而不是「它的注意力机制有什么新变种」。

这跟 2019 年深度学习的轨迹惊人地相似。当 PyTorch 那篇 NeurIPS 论文拿到 113 分的时候,深度学习已经从学术突破转向了工程基建。现在 LLM 也走到了这一步。

Dylan 让 Claude 预测哪些 2023-2026 的论文会经得起时间考验,选出来的名单很有意思:

- DeepSeek-R1(1,351 分)— 用纯 RL 实现 o1 级推理的开源方案

- Generative Agents(391 分)— 经典的 Smallville 论文,LLM Agent 架构的模板

- BitNet b1.58(1,040 分)— 三值参数,低比特推理的第一个可信方案

- Differential Transformer(562 分)— 带噪声消除的注意力机制

这些论文的共同特点是什么?它们不只是提出了一个理论,而是给出了一个可以直接拿去用的方案。这正好印证了上面的判断 — 社区的兴趣已经从「理解原理」转向了「解决问题」。

对开发者意味着什么

如果你是一个关注 AI 前沿的开发者,这个趋势有几个实际含义:

1. 论文不再是获取信息的最佳渠道。 模型能力的提升越来越多地以产品更新的形式发布,而不是论文。GPT-5.5 的发布、Claude Opus 4 的能力升级,这些关键信息首先出现在官方博客而非 arXiv。

2. 工程实践比理论创新更稀缺。 怎么设计一个可靠的 Agent 工作流、怎么处理多模型之间的 fallback、怎么在生产环境中做 prompt 版本管理 — 这些问题没有论文教你,得靠实战。

3. 技术选型的速度在加快。 当新论文不再是关注焦点时,社区的注意力转向了工具和平台。谁能更快地把模型能力变成可用的 API,谁就能吸引开发者。

HN 的 arXiv 论文占比只是一个缩影。整个 AI 行业正在经历从「论文驱动」到「产品驱动」的转变。这不是坏事 — 这意味着技术正在成熟。

如果你在日常开发中需要快速切换不同 AI 模型来验证方案,推荐试试 OfoxAI(ofox.ai)— 一个账号接入 Claude、GPT、Gemini 等主流模型,不用在多个平台之间来回跳转。